数据工程实战:高质量数据集系统化指南

方法论笔记 · 数据工程 × 大模型训练 × 治理 | 2026 年 5 月 | 约 18 分钟阅读

引子:为什么 2026 年还要重新讲一遍"高质量数据集"

模型架构在 2024–2026 年这两年悄悄收敛了。Transformer 的几种变体大同小异,开源框架成熟到一周就能跑起来一个新模型。算力差距虽然还在,但已经不再是决定能力上限的唯一变量。真正把不同团队拉开档次的,是它们手里的数据。

从 LIMA 到 Phi 到 Alpagasus,近两年反复被验证的一个结论是:少量精选数据在 SFT 阶段可以打赢数量级更大的粗标数据集。模型能力的天花板,越来越多由数据质量定义。

但奇怪的是,"高质量数据集"在很多团队里仍然是一个被严重套路化的词。提需求时一句"要高质量",落到执行就变成"多招标注员、多花钱、多审核"。最后做出来的数据集,可能在某个维度做到了极致,整体却完全没法支撑下游训练。

这篇文章只做一件事:把"高质量数据集"这件事系统拆开——它由哪些维度组成,这些维度怎么互相打架,不同任务下侧重点为什么差异巨大,以及如何用一个可复现的工程流程把它建出来。

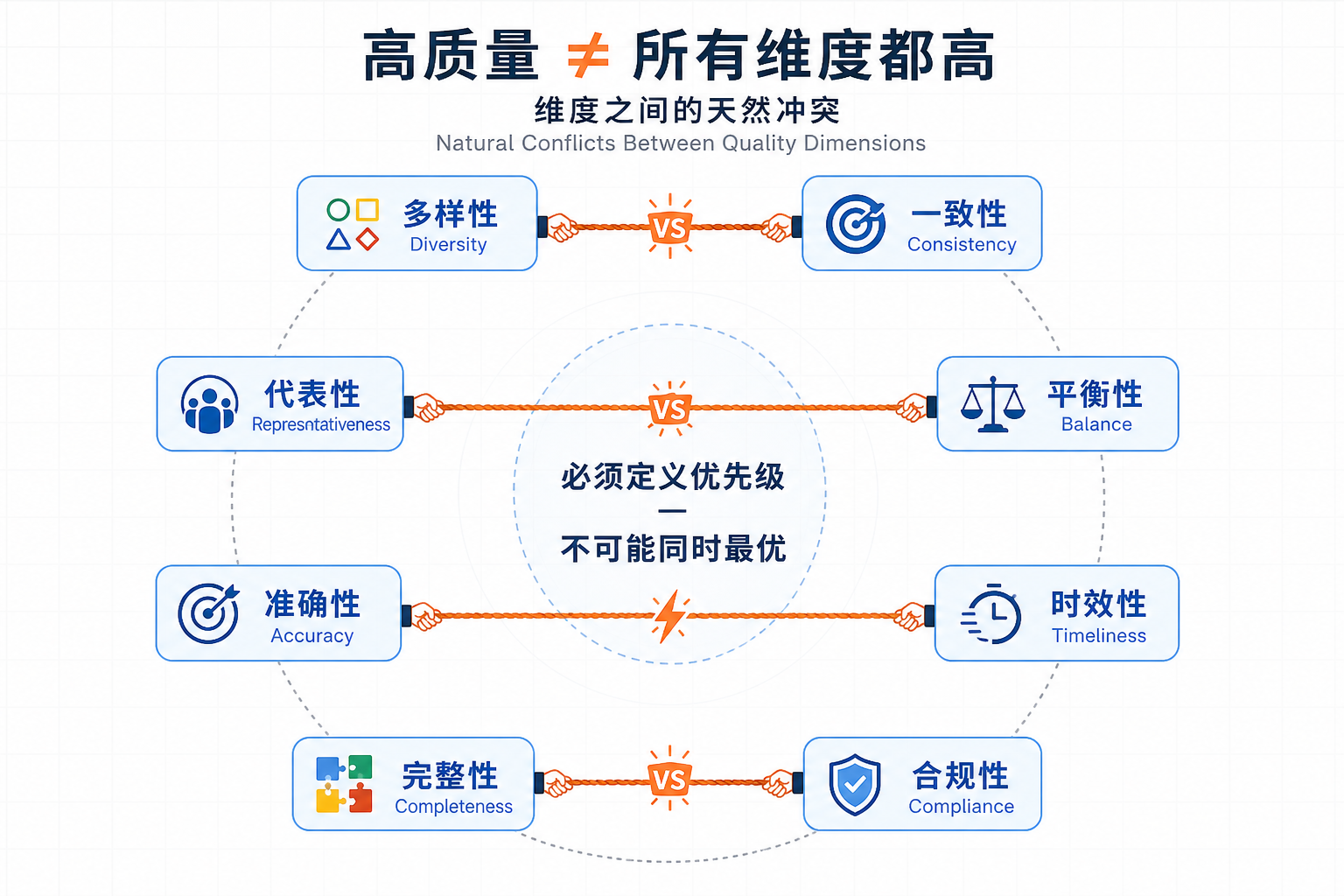

一、"高质量"不是一个指标,是一组互相打架的维度

很多文档喜欢给数据质量列个十二维评估表,看起来很全面,但这种列表的最大问题是它假装这些维度可以同时被优化。实际上不能。任何真正做过数据集的人都知道:你抬高一个维度,必然要按下另一个维度。

下面这张表先把常见维度过一遍,每个维度配一个具体的"坏例子",让你立刻能对号入座自己手上的数据集。

| 维度 | 含义 | 一个典型坏例子 |

|---|---|---|

| 准确性(Accuracy) | 标签和事实正确,无错标、无幻觉 | 客服问答数据集中答案与产品文档矛盾 |

| 一致性(Consistency) | 同类样本在标注规范下处理一致 | 同一类实体在不同样本中边界划得不一样 |

| 完整性(Completeness) | 字段无缺失、覆盖目标场景 | 多轮对话只留了第一轮和最后一轮 |

| 多样性(Diversity) | 话题、语言、风格、难度足够广 | 100 万条 SFT 全是闲聊和问候 |

| 代表性(Representativeness) | 数据分布贴近真实业务/世界 | 训练分布与上线分布严重错位 |

| 平衡性(Balance) | 类别、人群、长尾不被严重忽视 | 正负样本 99∶1 |

| 去重(Deduplication) | 无精确/近似重复 | 网页爬取里大量模板化重复 |

| 无偏性(Fairness) | 减少性别、种族、地域等社会偏见 | 简历数据 95% 是男性工程师 |

| 时效性(Freshness) | 反映当下知识,未过期 | 2018 年的政策法规数据 |

| 可追溯性(Provenance) | 来源、采集方式、版本可回溯 | 不知道某条样本来自哪个网站 |

| 合规性(Compliance) | PII、版权、许可证合规 | 含未脱敏身份证号、未授权书籍 |

| 无污染(Uncontaminated) | 评测集未泄漏到训练集 | benchmark 题目混进预训练语料 |

把表读完之后,真正的关键来了:这些维度之间是天然冲突的。

我列几个最常见的对:

- 多样性 vs 一致性:你想让样本风格丰富多变,就不能用一套死规范去捏所有样本;反过来,规范越严,样本越像一个模子刻出来的。

- 代表性 vs 平衡性:真实分布里某些类别天然就少(比如金融欺诈样本只有 0.1%),你想保留代表性,就要接受类别失衡;想做平衡采样,就要接受分布失真。

- 准确性 vs 时效性:刚发生的事件标注最不准(事实还在演化),但又最有时效价值;等事实稳定了再标,时效性已经过了。

- 完整性 vs 合规性:完整保留用户信息最完整,但和隐私合规直接冲突;脱敏完了,下游某些任务就废了。

- 多样性 vs 准确性:长尾样本最能扩展能力边界,但长尾也是最容易标错的地方(标注员遇到陌生 case,质量必然下滑)。

所以"高质量"必须先定义优先级:哪些维度是 must-have、哪些是 nice-to-have、哪些可以妥协。脱离任务谈所有维度都"高",等于什么都没说。

二、不同任务下,"高质量"的画像差别巨大

同一份数据,对一个任务是宝,对另一个任务可能就是垃圾。要避免误解,最好的办法是把不同训练阶段的"质量画像"摆在一起对比。

| 数据类型 | 最关键的几个维度 | 容易被忽视的雷区 |

|---|---|---|

| 预训练语料(Pretraining) | 规模、多样性、去重、合规、低毒性 | 重复内容会让模型死记硬背;评测集污染会让指标虚高 |

| 指令微调(SFT) | 指令多样性、回答正确性、格式一致性 | 任务分布过窄会让模型其他能力衰退 |

| 偏好对齐(RLHF / DPO) | 标注者一致性、偏好区分度、难度梯度 | 偏好对差异太小,奖励模型学不到任何信号 |

| 评测集(Benchmark) | 代表性、难度、无污染、抗作弊 | 评测题被训练集"看过"是最常见的暗坑 |

| 垂直行业数据 | 领域覆盖、专家准确性、术语规范 | 领域专家与标注员脱节,规范实际上没人懂 |

| 多模态数据 | 模态对齐质量、文本描述粒度、跨模态一致性 | 图像-文字弱相关时,模型学的是噪声 |

| Agent 训练数据 | 工具调用正确性、轨迹完整性、错误轨迹比例 | 全是成功轨迹会让 Agent 不会处理失败 |

读完这张表,应该能感受到一件事:任何在不区分任务的情况下谈"高质量"的方法论,都只能停在抽象层。 真正的工程动作必须落到具体任务上。下面在进入具体方法之前,先把 2026 年中国官方的"高质量数据集"定义讲清楚——它和我们刚刚的工程论惊人地一致,但有自己鲜明的政策语境。

三、中国语境:从《高质量数据集建设指引》看官方定义与建设导向

如果你在中国做数据集,2026 年这个时间点上有一件事绕不开——国家数据局、网信办等部门已经把"高质量数据集"提升到了国家战略基础设施的层面。从早期的"民间自发清洗"到今天的顶层设计,国内对高质量数据集的提法已经完成了一轮范式转移。这一节专门讲清楚官方视角,它和你脑子里的工程定义会比想象中更接近,也比想象中更有政策协同性。

顶层定位:从"静态文件"到"动态战略资产"

国家数据局牵头编制的《高质量数据集建设指引》给出了一个非常工程化的定义:

高质量数据集是指用于训练、验证和优化人工智能大模型而收集、整理、标注形成的,覆盖行业核心专业知识和生产经营活动信息的数据资源集合。

读懂这条定义,关键在三个隐含判断:

- 范式转移已被官方承认——指引里明确提出"大模型时代研发重点已从'重点优化模型架构'转向'模型与数据协同优化'"。这与本文开篇的判断完全一致:架构在收敛、数据成为差异化护城河。

- 资产观全面升级——数据不再是"一次性收集、处理后就束之高阁的静态文件",而被定义为"需要持续投资、管理、监控和优化的动态、演进的战略资产"。这其实就是后文"七步闭环"在政策语言下的另一种表达。

- 任务锚定写进了定义——明确"用于训练/验证/优化大模型",而不是泛指任意数据集。这与第二节强调的"高质量必须绑定任务"在精神上是相通的。

核心特征:官方"三高"标准

官方在评价与筛选层面提炼出了高质量数据集的 "三高" 特征——这套标准在 2025–2026 年成为各级数据局立项、典型案例评选的核心依据。把它和工程视角对照来看,会发现政策侧和工程侧高度协同:

| 三高特征 | 官方表述 | 对应的工程含义 | 典型应用领域 |

|---|---|---|---|

| 高价值应用 | 紧扣实体经济与产业升级,切实解决行业痛点 | 任务导向、有明确下游、能产生经济价值 | 工业质检、医疗辅助诊断、能源调度 |

| 高知识密度 | 拒绝低价值的行业噪声与 AI 代生的"通胀数据",强调行业专家知识沉淀 | 多样性 × 准确性的乘积,反对水军式合成 | 行业专家深度参与的领域知识库 |

| 高技术含量 | 涉及复杂的多模态对齐、全链路质量检测、隐私安全治理 | 工程门槛、技术深度、合规可控 | 多模态、跨域融合数据集 |

特别值得一提的是,"高知识密度"明确反对"AI 代生的通胀数据"——这恰好与本文后面要讲的"警惕合成数据反噬"在结论上一致。中国官方层面已经把这件事写进了正式文件,而不再仅仅是某个研究者的个人见解。

三大演进趋势:从典型案例看官方导向

国家数据局陆续遴选并公开了若干"高质量数据集典型案例"。把这些案例横向对比,可以看出 2025–2026 年中国数据集建设的三条明确演进路线:

| 演进趋势 | 具体表现 | 代表案例 |

|---|---|---|

| 多模态主流化 | 摆脱纯文本,强调"文本 + 图像 + 语音 + 时空"全维度覆盖,公开案例占比超 60% | 湖北「北斗『通导遥一体化』应急数据集」 |

| 跨领域融合化 | 主动打破行业"数据孤岛",进行跨行业、跨场景数据重组 | 「交通 + 能源」数据集(整合车流与天然气运输) |

| 规模与语料本土化 | 强调亿级 Token / 样本规模,提升国产大模型中文适配与"多语种出海"能力 | 中国移动「通用高质量数据集」(超 3500TB) |

把这三条趋势翻译成工程语言:

- 多模态主流化——意味着对齐工程的门槛系统性提高了。北斗「通导遥一体化」把通信、导航、遥感三类完全异构的数据按时空维度对齐,这是普通团队几乎不可能独立完成的政企协同产物。

- 跨领域融合化——「交通 + 能源」这种数据组合在欧美是相对罕见的,国内由于政企数据互通机制更顺畅,反而成了独特优势。但融合不是简单拼接,跨域 schema 对齐、口径统一、血缘追踪都是硬骨头。

- 规模与语料本土化——3500TB 已经接近国际头部预训练语料库(C4、RedPajama 等)同级别。这也意味着预训练阶段的中文语料供给侧改革,是 2026 年最值得关注的工程方向之一。

政策语境下的几条提醒

把官方导向和工程实践放在一起看,至少有四条值得团队特别注意:

- 政策定义和工程定义并不冲突,反而高度协同。"动态战略资产"的提法和本文方法论框架的精神完全一致——区别只在于政策侧更强调战略价值与产业落地,工程侧更强调可复现 pipeline 与质量度量。

- 政企协同正在成为"超大规模高质量数据集"的唯一可行路径。 北斗一体化、交通+能源这类数据集,单一企业不可能独立完成,必须依赖政府牵头的跨域协同。这意味着民间团队短期内更适合在垂直领域、中等规模上做精细化建设,超大规模交给国家队。

- 合规、技术、应用三位一体已经成为评选典型案例的硬门槛。"高技术含量"里明确包含"隐私安全治理"——合规不再是事后补救,必须前置进设计。

- 国产大模型的中文与本土化能力建设,已经从"模型问题"显性转化为"数据问题"。

接下来回到方法论——下面我们具体讲,要建设一份这样的高质量数据集,工程上应该走什么流程。

四、建设高质量数据集的七步闭环

把建设过程拆成七步,是为了让流程可复现——同一团队换了人也能跑、同一项目跨了季度也能续。每一步都讲清楚:要做什么、有哪些常用方法、有什么要特别小心的坑。

第一步:需求定义

很多团队一上来就开始"采数据",这是工程灾难的起点。第一步真正应该做的是写清楚 schema、标注规范、Data Card。具体动作有三件:

- 明确下游任务和评估指标。不是"做一个客服对话数据集"这种模糊描述,而是"用于训练 7B 模型的多轮客服对话 SFT 集,目标在 BLEU/ROUGE 上提升 X%、在人评通过率上 ≥ Y%"。指标决定了你后面每一步要怎么取舍。

- 写出标注规范文档。包含正反例、边界 case、争议案例的处理原则。一个常用经验是:正反例数量至少各 30 个,且要包含"模糊带边界"的样本——这是规范是否经得起推敲的真正检验。

- 写一份 Data Card。这一实践最早由 Gebru 等人在《Datasheets for Datasets》论文中提出。它强迫你回答:数据为谁服务、来源是什么、已知偏差是什么、不适用于哪些场景。看起来像形式主义,实际上能在动手前就过滤掉 70% 的方向性错误。

第二步:数据采集

采集阶段的核心不是"采多少",而是"采什么、从哪儿采、能不能记下来"。

来源要多样化。常见来源有自有日志、公开数据集(HuggingFace、Common Crawl)、采购、爬虫、合成数据。预训练阶段的常见配比大致是网页 60% / 代码 15% / 书籍 10% / 论文 5% / 多语言 10%,但这只是参考起点,每个团队要根据下游目标调。

每条数据都要带"元信息"。 至少包含:source(来源 URL 或数据集名)、license(许可证)、timestamp(采集时间)、采集脚本版本号。这些信息现在不记,等到合规审查、版本回滚、血缘追踪时再补,几乎是不可能的——你会面对一堆"不知道哪儿来的数据"。

别忽视采集时的偏差。一个简单的反例:你只爬了某几个高质量论坛,结果数据分布严重偏向某种风格——模型学完之后说话像论坛 KOL,无法适配通用场景。

第三步:数据清洗

清洗是最容易自动化、也最容易"做漏"的环节。完整的清洗 pipeline 通常包含以下几个动作:

| 环节 | 常用方法 / 工具 | 说明 |

|---|---|---|

| 语言识别 | fastText、CLD3 | 过滤掉非目标语言或乱码 |

| 启发式过滤 | 正则规则 | 标点比、行长度、字符多样性、重复字符比 |

| 困惑度过滤 | KenLM | 过滤掉乱码、机器生成低质量内容 |

| 去重 | MinHash + LSH、SimHash | 精确去重 + 近似去重,两层都要做 |

| 有害内容过滤 | 关键词表、毒性分类器、NSFW 分类器 | 多层兜底,避免单一规则被绕过 |

| PII 脱敏 | 正则 + NER(姓名/手机号/邮箱/身份证) | 精准 + 召回兼顾,必要时人工抽查 |

| 格式标准化 | trafilatura、html2text | HTML 转 Markdown、编码统一 |

| 异常值剔除 | 长度分位、字符分布检测 | 干掉过短/过长/异常分布样本 |

经验法则:清洗规则永远不要一次写死。 先抽样观察 100~500 条 badcase 再迭代,每加一条规则都要看它影响了多少样本(best practice 是每条规则的影响要可见、可逆)。

第四步:数据标注

标注是人力密集型环节,也是质量瓶颈。一个成熟的标注流程长这样:

- 培训:标注员读完规范文档,看完正反例。

- 试标:每人标 50~100 条,由项目方逐条审核,找出认知偏差。

- 一致性测试:每两人之间计算 Cohen's Kappa,要求 ≥ 0.7 才能进入正式标注。

- 正式标注:单人标注 + 抽样审核,关键样本进入双人交叉。

- 仲裁:双人不一致的样本进入第三方仲裁,仲裁结论反哺规范文档。

- 持续质检:随机抽 5%~10% 重复审核,发现某标注员通过率下滑就立刻暂停。

怎么降本? 主要靠三招:

- 主动学习(Active Learning):让模型挑出最不确定的样本优先给人标,标注效率能提升 2~5 倍。

- 预标注 + 人工校对:先用 LLM 粗标一遍,人只做修正——比从零标快 3~10 倍,但要警惕"人工懒得改"导致 LLM 错误被无脑接受。

- 弱监督(Weak Supervision):用 Snorkel、规则函数生成大量噪声标签,再用模型自己去除噪声。这条路适合规则清晰、人力极贵的场景。

第五步:质量评估

质量评估必须分两种来看,缺一不可。

静态评估——看的是数据本身的属性:抽样人审通过率、PII 残留率、重复率、语言分布、长度分布、毒性比例。这些指标能在数据"还没用"时就告诉你它的健康度。

动态评估——看的是数据"用了之后怎么样"。最经典的方法是 小模型 ablation:用一个小规模、同架构模型跑两组实验——基线(不加这批新数据)vs 加了新数据。如果新数据真的有质量,下游指标应该提升;如果没提升甚至下降,说明这批数据的"质量"是假象。

污染检测——是评测集的命门。常用方法是 n-gram overlap:把评测集的题目切成 n-gram,去训练集里查重叠率。重叠率超过阈值(一般是 8-gram 重叠 > 5%)就认为污染,必须重新构造评测集。

第六步:数据治理

到这一步,你已经有了一份能用的数据集。但如果不做治理,它最多撑 3~6 个月就会变成"无人能维护的黑盒"。治理的几个核心抓手:

- 版本管理:用

DVC、LakeFS、HuggingFace Datasets给数据打版本号。任何下游模型都要记录它训练时用的数据版本。 - 血缘追踪(Lineage):每条样本要能回溯到来源、清洗规则版本、标注员、仲裁记录。这件事在合规审计时是救命的。

- 合规审查:定期 review 是否符合 GDPR、《数据安全法》《生成式 AI 服务管理办法》、各数据集的 license 兼容性。

- 可复现 pipeline:清洗、标注、评估的每一步都要是代码(不是 Excel),且有 commit hash。换个人也能复现整套流程。

第七步:闭环迭代

数据集不是一次性产物,它必须和模型形成闭环。具体做法有几种:

- 线上 badcase 回流:模型预测错的样本要被自动收集,进入下一轮标注队列。

- 拒绝采样 / Best-of-N:用奖励模型筛选高质量回答,补充进 SFT 集。

- 合成数据 + 真实数据混合:合成数据可以放大规模,但必须配合真实数据兜底,避免 Model Collapse。

- 持续评估:每个版本数据集都要在固定评测集上跑一遍,看趋势是否健康。

走完七步,你拥有的不是一份 csv,而是一套可以持续生产高质量数据的能力。这个差别,就是为什么有些团队的数据集越用越好,有些团队的数据集越用越烂。

五、工具链全景:选对工具能省一半力气

下表把各个环节的常用工具列出来,作为快速参考。不要试图一次引入全套,按团队规模和预算分阶段建设。

| 环节 | 推荐工具 | 适用阶段 |

|---|---|---|

| 语言识别 | fastText、CLD3 | 任意规模 |

| 网页正文抽取 | trafilatura、readability-lxml、Resiliparse | 爬虫场景 |

| 困惑度过滤 | KenLM | 大规模预训练 |

| 去重(精确) | hash + DB index | 任意规模 |

| 去重(近似) | MinHash + LSH、SimHash、datasketch 库 | 中大规模 |

| PII 检测 | Presidio、spaCy NER、自训正则 | 涉及用户数据时必备 |

| 毒性 / NSFW | Detoxify、Perspective API、NSFW classifier | 公网爬取必备 |

| 标注平台 | Label Studio、Prodigy、doccano、Scale | 团队规模决定自建/外采 |

| 主动学习 | modAL、small-text | 标注成本高时 |

| 弱监督 | Snorkel、skweak | 规则清晰场景 |

| 版本管理 | DVC、LakeFS、HuggingFace Datasets | 任意规模都该上 |

| 血缘追踪 | OpenLineage、DataHub | 中大规模团队 |

| 实验跟踪 | Weights & Biases、MLflow | 训练阶段 |

| 污染检测 | 自写 n-gram overlap 脚本、lm-evaluation-harness 内置工具 | 评测前必跑 |

六、十条容易踩的坑(带解释,不是简单 bullet)

最后这一节是我和团队这些年踩过的坑总结,每一条背后都有真实的工程教训。

1. 宁缺毋滥。 在大模型 SFT/对齐阶段,1k 条精数据胜过 50k 条噪声数据——但这不等于"每条都要精雕细琢"。真正的质量是单条质量与多样性的乘积,只拉一边是不够的。盲目堆量只会让模型学到噪声里的虚假规律。

2. 多样性 > 单条质量——但两者是乘法关系。 1 万条全是数学题的 SFT 集,会让模型其他能力全崩。为什么"质量 = 单条质量 × 多样性"、以及怎么做多样性审计,姊妹篇《七个明确观点》的观点二有完整论述。

3. 标注规范要"可证伪"。 模糊的"请标注得自然一些""请合理判断"会导致一致性灾难。规范必须能让两个不认识的标注员看完,对同一个样本给出几乎一样的答案。如果做不到,规范本身就有问题。

4. 评测集要尽早封存。 评测集一旦泄漏到训练集,整个项目的指标都失去意义。我的建议是:评测集必须在数据建设的最早期就单独构造、单独存储、单独审计,并且永远不要进入任何训练 pipeline。每次模型训练完都要做污染检测。

5. Data Card 先行,不是事后补。 Data Card 不是形式主义,它逼你在开工前回答清楚目标、来源、偏差、适用范围。太多团队做完数据集才开始补 Data Card——这时候已经晚了。为什么 Data Card 应被视为工程纪律而非文档负担,以及要回答的 7 个关键问题,见姊妹篇《七个明确观点》的观点六。

6. 警惕合成数据反噬。 纯合成训练会导致 Model Collapse——能力分布越来越窄、长尾能力快速丧失。经验法则:合成比例不超过 50%,且必须经过拒绝采样或奖励模型筛选。更详细的分析和落地建议见姊妹篇《七个明确观点》的观点五。

7. 长尾才是真正的成本所在。 数据集里最贵的不是常见样本——常见样本可以批量采集、批量标注。真正贵的是那些很少出现但很关键的长尾样本。比如医疗诊断数据集里的罕见病、客服对话里的极端纠纷。预算的大头要砸在长尾上。

8. 标注员管理是隐性瓶颈。 大规模标注项目的隐性瓶颈不是工具,是人。标注员的疲劳、情绪波动、对规范的理解漂移都会让质量在第 3 个月开始悄悄下滑。质量监控必须前置到流程内部,而不是事后审核。

9. 数据集要"活着",而不是"上交"。 一个项目最常见的失败模式是:数据集 v1.0 交付之后再也没人维护。但业务在变、模型在升级、合规要求在变化——v1.0 注定会过时。预算和资源必须给到 v1.x、v2.x 的持续迭代,否则前期投入会白费。

10. 每个数据集都该有一个"主人"。 数据集没有 owner,等于没人为它的质量负责。每份数据集要有一个明确的 owner 工程师/团队,对它的版本、文档、合规、迭代负全责。这条管理学层面的规则,比任何工具都重要。

七、小结:把"数据集建设"当成一种长期能力

回到一开始的问题——什么叫高质量数据集,怎么建? 走完这一圈,应该能看出来:

1. 高质量没有普世标准,它是任务+维度+优先级的组合。 任何只列十几个维度而不区分任务的"高质量"定义,都是在偷懒。

2. 高质量是建出来的,不是采出来的。 七步闭环里只有一步是"采集",其他六步都是建设。为什么"数据集建设"应当被视为一种长期组织能力而非一次性项目,姊妹篇《高质量数据集的七个明确观点》的观点三有更深入的论述。

3. 工具决定下限,组织决定上限。 工具链可以买、可以学,但规范、流程、复盘机制才是真正决定数据集长期质量的护城河。

4. 闭环优于完美。 与其追求一次做到完美,不如先跑通"线上反馈 → 数据更新 → 模型迭代"的闭环。在迭代中收敛的数据集,比一次性精雕的数据集更可靠。

5. 在中国语境下,政策导向与工程方法高度协同。 国家数据局《高质量数据集建设指引》提出的"动态战略资产 + 三高"框架,与本文方法论几乎一一对应——但政策给方向、典型案例给参考,最终决定数据集是否真正可用的,仍然是你自己团队的工程能力。

如果你看完这篇仍然觉得"系统化方法虽然全面但缺少态度",可以接着看姊妹篇——《高质量数据集的七个明确观点》,那一篇就只讲态度,不讲流程。

本文是 ICE 数据系列的方法论笔记,不构成投资或决策建议。文中提到的工具、案例、论文均可在公开渠道查证。欢迎讨论、指出疏漏。