Agent-to-Agent:当 AI 开始和 AI 对话,对话量将爆炸式增长

技术解读 · Agent 通信 × 协议工程 × 基础设施 | 2026 年 5 月 | 约 12 分钟阅读

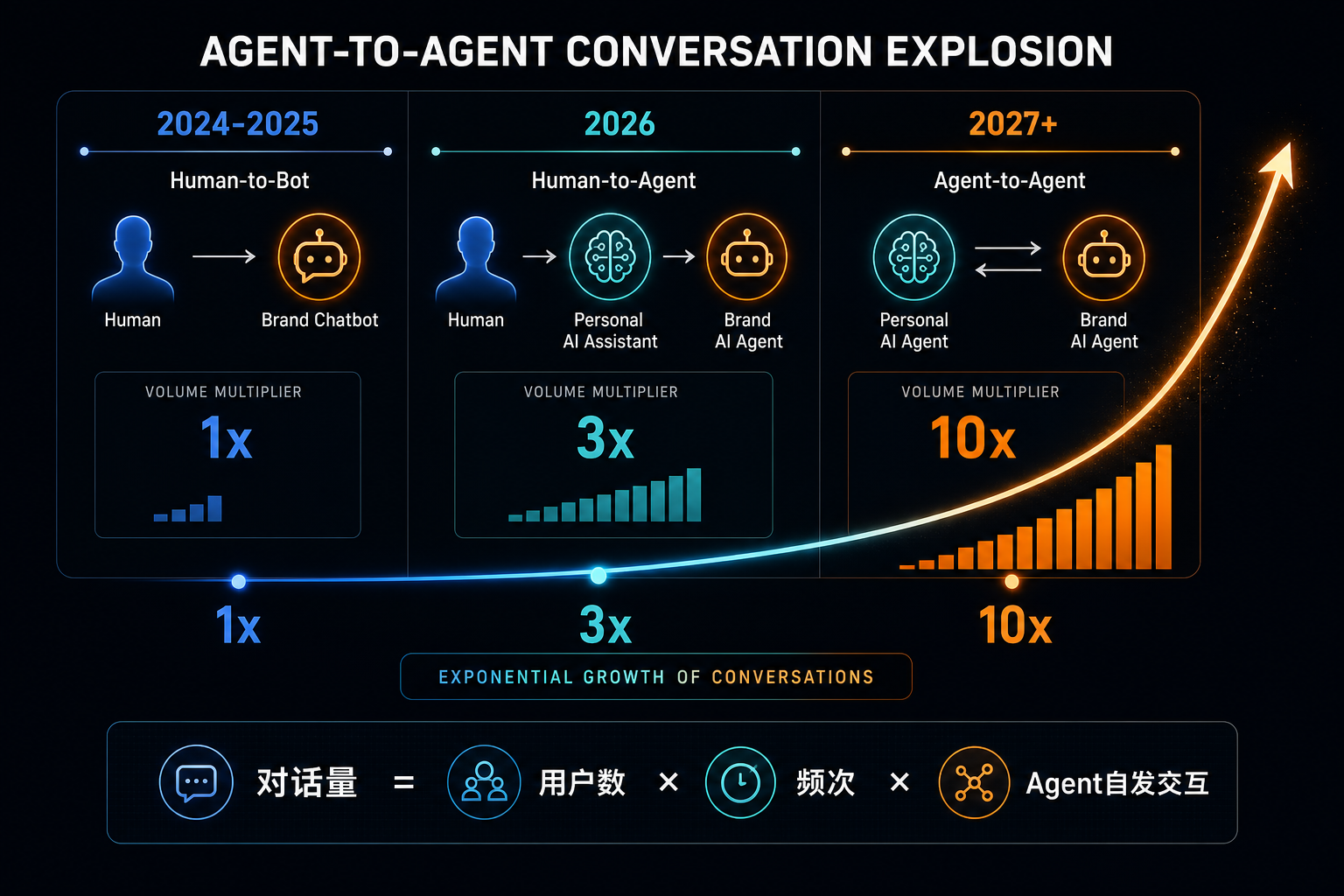

为什么"对话量"的增长公式变了

过去十年,通信平台的增长公式很简单:对话量 = 用户数 × 频次。更多的人、更频繁地发消息,生意就好。

2024 年起,AI 客服机器人开始承担越来越多的对话。但本质上,对话的一端仍然是人。用户的增长天花板决定了对话量的天花板。

现在,这个公式正在被改写:

对话量 = 用户数 × 频次 × Agent 自发交互倍数

当你的个人 AI 助手(Siri、Gemini、Claude)替你去和品牌的 AI 代理对话——比价、改签、投诉、续费——每一次"用户意图"可以触发数十轮 Agent 之间的协商。对话的两端都是机器,人类从"参与者"变成了"审批者"。

这就是 Agent-to-Agent(A2A)——下一个对话量的爆点。

Human-to-Agent vs Agent-to-Agent:本质不同的两种对话

很多人以为 A2A 只是"换了个对端的 Human-to-Agent"。这种类比会带来严重误判——这两种对话在工程层面几乎没有共通点:

| 维度 | Human-to-Agent | Agent-to-Agent |

|---|---|---|

| 延迟容忍度 | 秒级(用户能忍 2–5 秒思考时间) | 毫秒级(多轮协商场景下,每轮延迟会被乘倍数放大) |

| 信息结构化程度 | 自然语言为主,含糊、省略、口语化 | 强结构化(JSON Schema、Agent Card、Artifact) |

| 单次任务对话轮数 | 1–3 轮(用户没耐心) | 数十至上百轮(Agent 不嫌烦,会反复确认细节) |

| 错误处理 | 用户重新提问 | 自动重试 / 回退 / 升级到人类裁决 |

| 身份信任 | 隐式(账号登录即可) | 显式(签名 Agent Card + 加密通道) |

| 计费模型 | 按消息条数或会话 | 按 Token / Task / 工具调用 |

三个最关键的差距值得展开一下:

- 延迟:Human-to-Agent 中 3 秒的延迟用户感觉不到;Agent-to-Agent 中 3 秒延迟意味着一次完整任务可能多消耗几分钟。当下游还有更下游的 Agent 在等,整条调用链会被堵住。

- 结构:人类容忍模糊"帮我订个便宜点的航班";Agent 必须把"便宜"翻译成具体的价格上限、时间窗、机型偏好——并且双方对字段的语义达成一致。这是 A2A 引入 Agent Card 和 Artifact 的根本原因。

- 轮数:人对一笔订单最多问 3 次。Agent 之间为了对齐"什么算便宜"、"靠窗位置是否硬约束",可以来回交换数十条消息。对话量 10 倍的来源就在这里。

数据说话:10 倍增长已在路上

几组关键预测勾勒出这场变化的量级:

Juniper Research(2026.01): AI 驱动的客户交互将从 2025 年的 33 亿次增长到 2027 年的 340 亿次——增幅超过 1000%。驱动力是 Agent 的 always-on 特性:它不睡觉、不排队、不等回复。

IDC(2026.03): G2000 企业的 Agent 使用量到 2027 年将增长 10 倍,底层的 token 和 API 调用量将增长 1000 倍。这意味着基础设施必须为数量级跃迁做好准备。

Gartner(2025.12): 到 2027 年,三分之一的 Agentic AI 部署将使用多 Agent 协作模式——不同技能的 Agent 组团完成复杂任务。但 Gartner 同时指出:跨平台 Agent 通信协议的标准化仍然是最大瓶颈。

Sinch(2026.05): 在其《AI 生产悖论》报告中直接点明——下一个对话量爆点是 Agent-to-Agent,预计对话总量暴增 3—5 倍。当对话双方都是机器,基础设施的可靠性和授权边界设计将从"重要"变成"生死线"。

为什么现在:三个引爆点同时到来

引爆点一:个人 AI 助手全面开放

Apple 将在 iOS 27(WWDC 2026.06 公布)引入 Extensions 系统,允许 Claude、Gemini 等第三方 AI 服务接入 Siri。这意味着数十亿 iPhone 用户将拥有一个能替自己"出面办事"的 AI 代理。当用户说"帮我把航班改到下午",Siri 的后端 Agent 将直接与航空公司的 AI Agent 交涉——用户可能只在最终确认环节出现一次。

Google 的 Gemini、Microsoft 的 Copilot 早已在走同样的路。2026 下半年,"人人有个 AI 代理"从愿景变成默认配置。

引爆点二:A2A 协议从 Google 项目变成行业标准

Google 于 2025 年 4 月发布 A2A 协议。一年后的成绩单:

- 150+ 支持组织(企业软件、云厂商、咨询公司)

- GitHub 22,000+ stars

- 五语言 SDK(Python、JS、Java、Go、.NET)

- 2025 年 12 月通过 Linux Foundation 的 Agentic AI Foundation 进入基金会治理(与 Anthropic 的 MCP 协议并列)

- v1.0 规范在 2026 年初落地,新增签名 Agent Card、企业多租户、异步任务流

A2A 不再是 Google 一家的提案,而是一个有治理、有规范、有生产 SDK 的开放标准。

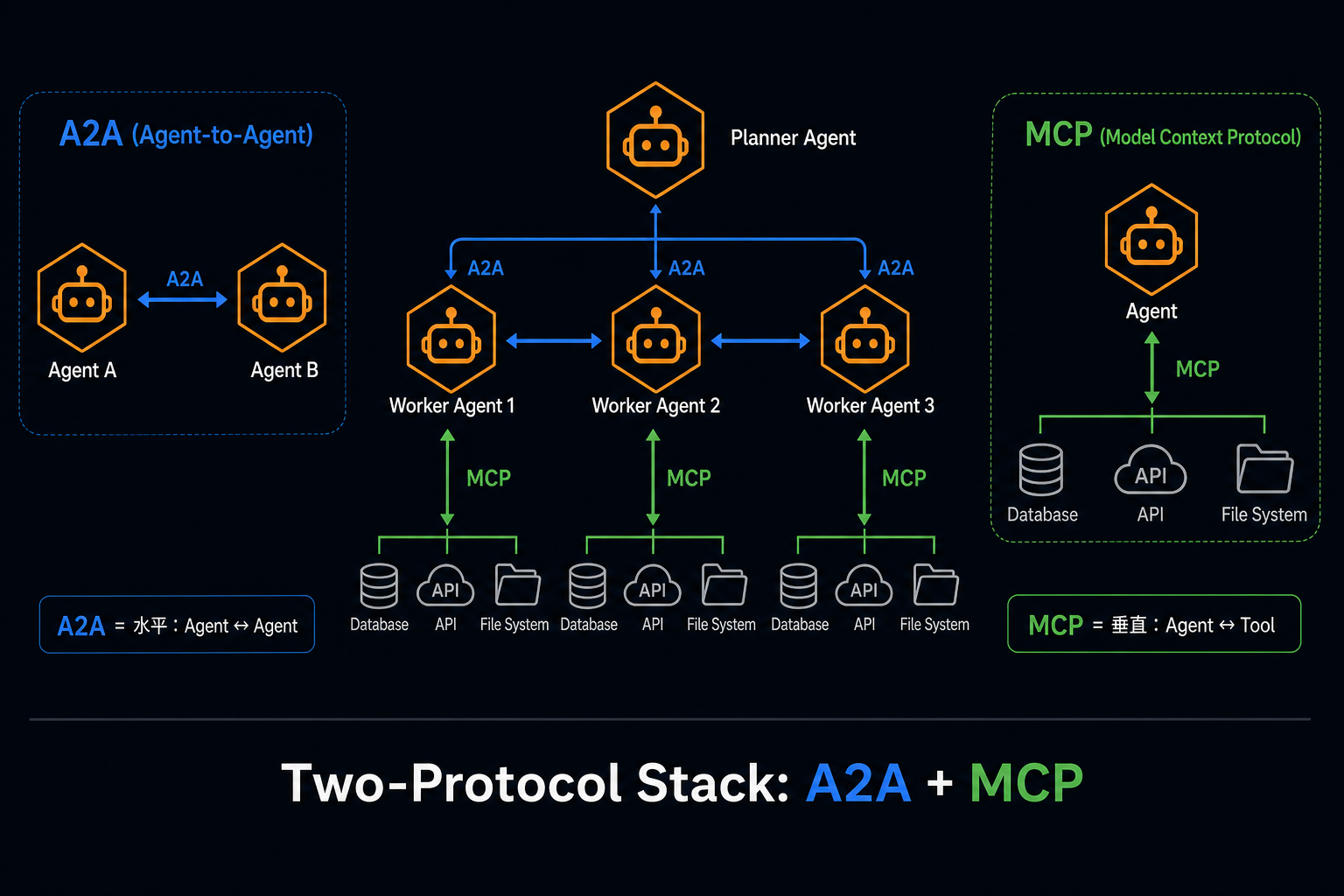

引爆点三:MCP 已打通 Agent → Tool,A2A 补上 Agent → Agent

Agent 的通信需要两层协议,就像互联网既需要 TCP 也需要 HTTP:

- MCP(Model Context Protocol) 解决纵向连接:Agent 怎么调用工具、读取数据

- A2A(Agent-to-Agent Protocol) 解决横向连接:Agent 怎么发现彼此、委托任务、协调执行

两者互补,缺一不可。一个 Planner Agent 通过 A2A 向多个 Worker Agent 分派任务,每个 Worker 内部再通过 MCP 调自己的工具链——这就是 2026 年多 Agent 系统的标准架构。

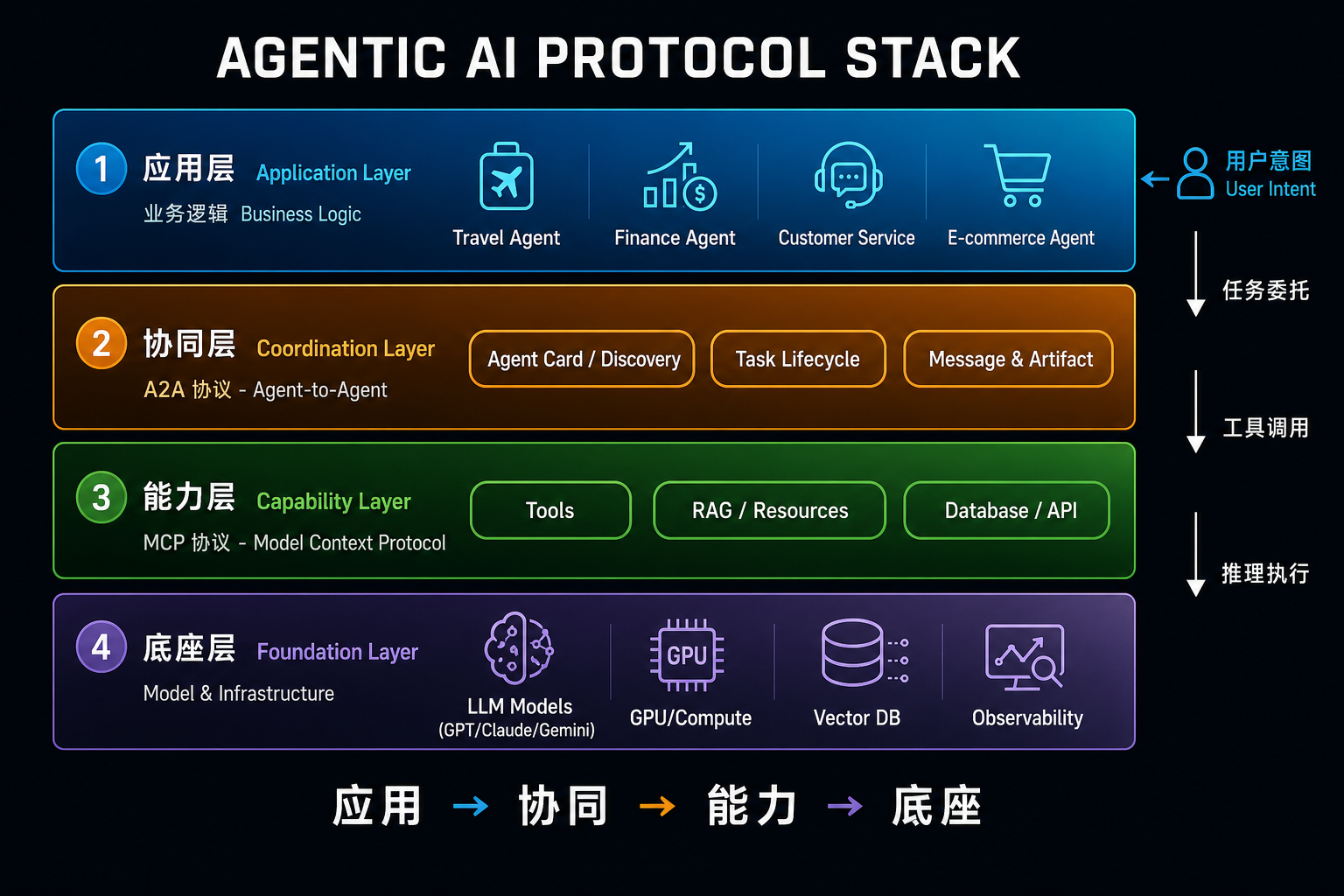

A2A 协议栈:四层架构看清整张地图

把 A2A 和 MCP 放回完整的 Agentic AI 协议栈,就能看到它们各自的位置和分工。整张技术栈像 OSI 一样自上而下分四层:

① 应用层 / 业务逻辑(Application) 具体的业务 Agent:旅行助手、金融顾问、电商导购、客服代理。这一层关心的是"用户要做什么",不关心协议细节。它消费下层提供的标准能力,把它们组合成一个个端到端的产品。

② 协同层 / A2A 协议(Coordination) 解决 Agent ↔ Agent 的横向连接,三个核心原语:

- Agent Card / Discovery:去中心化的身份和能力发现

- Task Lifecycle:有状态的任务生命周期与异步流

- Message & Artifact:富媒体、结构化的消息交换

这一层是 2026 年新冒出来的,也是空白最大的一层。

③ 能力层 / MCP 协议(Capability) 解决 Agent ↔ Tool 的纵向连接:工具调用、RAG 资源、数据库 API。MCP 在 2024 年底由 Anthropic 推出,到 2026 年初已经形成事实标准,Python/TS SDK 月装机量近亿、公开 MCP Server 超过一万。这一层相对成熟。

④ 底座层 / 模型与基础设施(Foundation) LLM(GPT、Claude、Gemini)、GPU/算力、向量数据库、可观测性。这是所有上层能力的物理底座。任何上层架构变化都会反向施压到这一层——IDC 那个"Token 增长 1000 倍"的预测,本质上是底座层将承担的扩容压力。

一句话总结: 应用层定义"做什么",协同层(A2A)定义"谁来做、怎么协作",能力层(MCP)定义"用什么工具做",底座层定义"在哪里跑"。A2A 是中间最薄、最新、最有机会的一层。

A2A 协议的核心机制

理解 A2A 不需要读完整个规范,抓住三个关键原语即可:

Agent Card:去中心化的"名片系统"

每个 Agent 发布一个 JSON 格式的 Agent Card,描述自己能做什么、接受什么输入、返回什么格式。其他 Agent 通过标准端点自动发现这张名片。v1.0 引入了加密签名,解决了"我怎么确认对面那个 Agent 真的是招商银行的、而不是钓鱼的"这个企业级信任问题。

Task:有状态的任务生命周期

A2A 不是简单的 request-response。一个 Task 有完整的生命周期:submitted → working → input-required → completed / failed。支持长时间运行的异步流(比如"帮我查三天后最便宜的航班"可能需要持续监控),客户端可以随时查询进度或取消。

Message + Artifact:富媒体交互

Agent 之间交换的不只是文本。A2A 原生支持文本、音频、视频、表单、iframe,甚至结构化数据文件。这让 Agent 之间的协作不限于"聊天",而是真正的任务协同。

谁会受到最大冲击

通信平台(CPaaS)

Sinch、Twilio、Vonage 这些按消息量计费的通信平台,将面对一个魔幻场景:对话量暴涨 10 倍,但发起对话的不再是人。定价模型、反欺诈策略、SLA 承诺全部需要重新设计。Sinch 率先推出"Agentic Conversations"平台能力,正是在抢占这一波结构性变化的先发位置。

企业客服与营销

当用户的 AI 代理直接来询价,它不会被"限时优惠"的心理战术打动。Brand Agent 需要学会和另一个理性的 Agent 谈判——这是一种全新的"对话设计",需要新的策略层。

基础设施和安全

Agent-to-Agent 场景下,以下问题变成刚需:

- 身份认证:对面的 Agent 是谁?代表谁?有什么权限?

- 授权边界:它可以查什么信息?可以执行什么操作?何时必须人工介入?

- 审计链:两个 Agent 之间的对话记录谁来保存?出了纠纷怎么追溯?

- 速率控制:一个 Agent 可以无限次来询价吗?怎么防止 Agent DDoS?

这些不是"后期优化"的问题。如果在设计阶段不考虑,上线后就是安全事故。

当前的差距与挑战

尽管趋势清晰,落地仍有明显障碍:

框架支持不均匀。 A2A 已有五语言 SDK,但主流 Agent 框架(如 LangGraph)至今缺乏一等公民支持。开发者仍需自行集成。

生产就绪度不足。 IDC 数据显示 79% 的企业已采用 AI Agent,但只有 11% 在生产环境运行。A2A 的生产案例更少。

治理体系空白。 "AI 代理可以共享什么、可以执行什么、何时必须人工介入"——这些问题目前还没有行业最佳实践。Gartner 预测的 Guardian Agent(守护代理)正是为此而生,但要到 2030 年才会占据 10-15% 的市场。

你现在该做什么

如果你在做企业通信、客服、或 Agent 平台,以下四件事值得立刻启动:

1. 给你的系统写一张 Agent Card。 定义清楚你的 Agent 能做什么、接受什么格式、返回什么结果。这相当于给你的服务注册一张"Agent 世界的名片",未来其他 Agent 发现你就靠这个。

2. 把授权边界当产品来设计。 "AI 代理可以查什么、可以做什么、何时升级到人工"不是安全团队的事,是产品定义的一部分。

3. 评估你的基础设施能不能扛住 10 倍对话量。 现在的消息队列、数据库、网关是为人类交互速率设计的。Agent 交互是毫秒级的连续对话流,吞吐量和延迟要求完全不同。

4. 关注双协议栈(A2A + MCP)。 不要只看 MCP(工具集成),也要跟进 A2A(Agent 互联)。两者是 2026 年 Agentic AI 的基础设施双柱。

参考

- Juniper Research, AI Agents to Power 1,000% More Customer Interactions by 2027, 2026.01

- IDC, Agent Adoption: The IT Industry's Next Great Inflection Point, 2026.03

- Gartner, Predicts Inter-AI Agent Collaboration by 2027, 2025.12

- Sinch, AI Production Paradox Global Research Report, 2026.05

- Google Developers Blog, Announcing the Agent2Agent Protocol (A2A), 2025.04

- AgentMarketCap, Google A2A Protocol at One Year: 150+ Orgs, 2026.04

- DigitalOcean, A2A vs MCP: How These AI Agent Protocols Actually Differ, 2026

- Apple/Bloomberg, Apple Plans to Open Up Siri to Rival AI Assistants in iOS 27, 2026.03

- Gartner, Guardian Agents Will Capture 10-15% of Agentic AI Market by 2030, 2025.06